フェイクニュースと闘うための信頼できる写真を目指して

2024年07月25日 木曜日

CONTENTS

はじめに

フェイクニュース、すなわち偽造されたニュース情報は、個人的被害や法的問題から社会不安、健康リスク、経済的損失、民主的プロセスへの脅威まで、劇的な結果をもたらす可能性があり、各国政府がこの脅威に対抗するための新たな法律を検討しているほどです。例えばこれやこれのような例があります。

操作された画像は特に強力な媒体であり、画像が文脈から外れ、元のメッセージが特定の目的に合わせて変更されます。最先端の画像処理技術を適用した検出技術も存在しますが、この記事で説明するように、操作の検出は容易ではありません。

幸いなことは、この問題に取り組んでいる人たちがいることです。この記事では、CAIとSerelayという 2 つのソリューションを紹介します。

なぜ、IIJ のような ISP がこれらのフェイクニュースを気にする必要があるのかと疑問に思う人もいるかもしれませんが、インターネット関係者は、これまでにスパム、ウイルス、サービス拒否などのネットワーク上の攻撃をフィルタリングしており、それらと同じインターネットにおける脅威としてフェイクニュースの拡散に着目しています。

操作された画像を検出する問題

偽の画像を検出するツールは多数存在します: fake-inversion、fotoforensics、invid plugin、fakeimagedetector など。これらのツールは、機械学習や画像処理技術によるピクセル分析に頼るか、インターネット上で類似画像を検索して画像の出所を見つけます。

残念ながら、次の 3 つの画像で示すように、これらのツールは十分ではありません。

最初の画像は、2019年のWWFコンテストからのものです。10年間の同じ森林を比較することで、アマゾンの森林破壊の程度を示しています。2番目の画像は、2021年のドイツでのワクチン反対デモとして、いくつかのソーシャルメディアで紹介されました。 3 枚目の画像は、「Rhein II」 と名付けられ、アンドレアス・グルスキーが 1999 年に撮影したものです。その後、アーティストは画像を編集して不要な詳細を削除し、このシンプルで抽象的な構成を作成しました。

これら3つの画像を、fakeimagedetector ツールを使って本物かどうかの判別をしてみました。このツールは、エラー レベル分析 (ELA) を利用してピクセル操作を検出します。結果は非常に驚くべきものでした。最初の画像は本物で、2番目と3番目の画像はコンピュータで生成されたか、修正されたという結果が出力されました。

最初の画像は、実は10年間にわたって同じ場所を写しているわけではありません。両側は同じ画像から取得されています。森林破壊は現実の問題ですが、このように操作された画像が利用されることで、気候のために闘う団体の評判を傷つける可能性があります。

2番目の画像については、操作はされていない本物ですが、2021年のドイツではなく、2011年のチリの学生抗議活動中に撮影されたものです。この画像が撮影された時間やGPS座標などの画像の追加メタデータの操作を行わずとも、任意の目的のために画像を再利用するのが簡単であることを示しています。

3番目の画像の大部分は本物ですが、作成者によってわずかに後処理されています。この 3 番目の例で指摘したいのは、AI 生成画像と実際の画像の違いが現在では非常に薄く、人々は AI 生成画像を本物だと信じているということです。真正性の記録がなければ、画像が AI 生成であるかどうかを偽って誰かを騙すのは非常に簡単です。

Exif メタデータは、画像が撮影された状況 (カメラ モデル、GPS 位置、日時など) に関する詳細情報を視聴者に表示することで、これらの操作を検出するのに役立つと考える人もいるかもしれません。残念ながら、いくつかの問題があります。まず、必須フィールドがありません。カメラメーカは、ファイルに埋め込まれるメタデータ (または埋め込まれないメタデータ) を決定でき、ユーザは画像を撮影する前にいくつかの設定を変更できます。2 番目に、このメタデータは、編集ソフトウェアによって変更または削除できます。3 番目に、画像ファイル形式は安全ではありません。真正性を証明するための署名や同様のメカニズムが埋め込まれておらず、不正な変更に対して整合性が保たれず、画像の真正性を証明できる機密情報 (紛争中に撮影された画像の GPS 位置など) が保存されていません。

要約すると、画像処理技術では、画像のピクセルが操作されているかどうか (画像の一部が変更されているなど) を検出できますが、画像とそれに関連するメッセージが視聴者を誤解させているかどうか (たとえば、画像が別の場所または別の時間に撮影されたように見せかけるなど) を検出することはできません。問題の一部は、現在の画像形式に安全なメタデータ (画像がいつどこで撮影されたかなど) がまったくないことです。Exif メタデータを削除または変更するのは比較的簡単です。

既存のソリューション

信頼できる画像、つまり出所と履歴を証明できる画像を作成するための既存のソリューションを 2 つ紹介します。

コンテンツ認証イニシアチブ

コンテンツ認証イニシアチブ (CAI) は、2019 年に Adobe、The New York Times、Twitter によって共同設立されました。その目標は、出所メタデータの業界標準を推進することです。設立以来、BBC、ARM、Qualcomm、さらには Nikon など、新しいアクターがこのイニシアチブに参加しています。

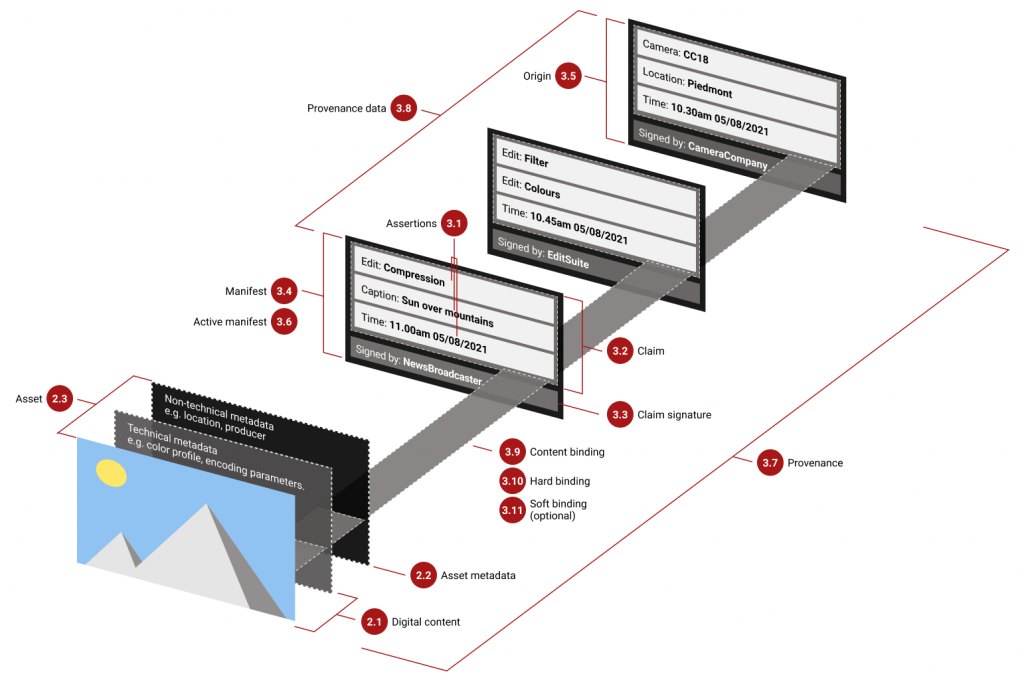

CAI は、カメラで撮影されたときや後処理されたときなど、画像の作成のさまざまな段階で安全なメタデータを追加するエンドツーエンドのシステムを提案しています (下の画像を参照)。この安全なメタデータには、画像の由来に関する追加情報(撮影日時、撮影者、公開者、変更方法など)が含まれます。この追加情報はハッシュとデジタル署名で保護されます。ユーザは画像を表示するときに、メタデータの信頼性と由来を確認できるため、画像に対する信頼性が効果的に高まります。

セキュア メタデータを別の場所 (サーバまたは別のファイル) に保存するのではなく、画像形式に埋め込むことで、このシステムはユーザにとって透過的になります。ユーザはリモート サーバに接続する必要がなく、画像の真正性を確認するためにインターネット接続を必要とせず、画像と一緒に別のファイルを保存または交換する必要もありません。

このアプローチの欠点の 1 つは、セキュア カメラが必要になることです。画像が通常のカメラで撮影された場合、その真正性を主張することはできません。幸いなことに、スマートフォンやカメラのメーカは、CAI と互換性のある新しいデバイスの開発に取り組んでいます。たとえば、Leica、Qualcomm、Nikon などです。

Serelay

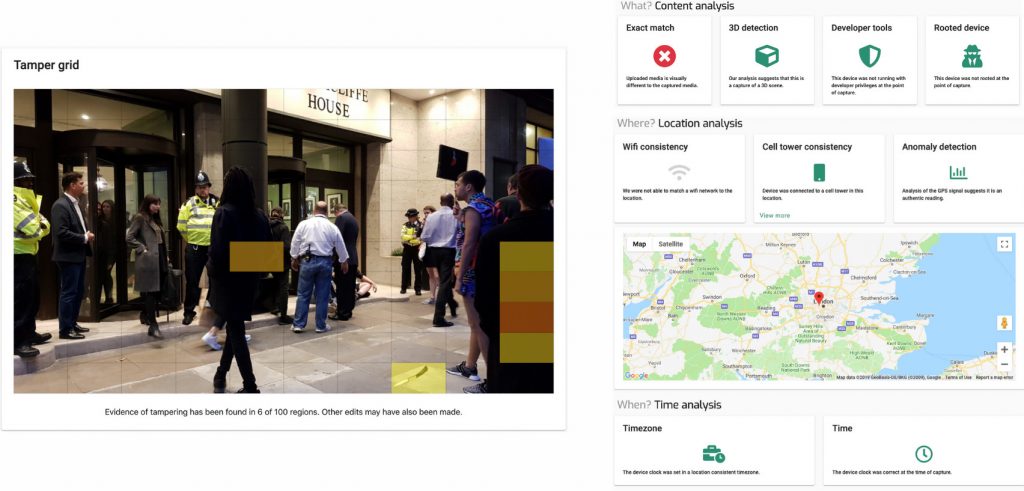

Serelay は、安全な画像を撮影するための 2 つの電話アプリケーションと、画像の真正性を検証するための SDK を提案している英国の企業です。画像を撮影する際、Serelay アプリケーションは、GPS 座標、近くの Wi-Fi ネットワーク、タイムゾーンを活用し、撮影者がデバイスの場所や時間を偽装しようとしていないことを確認するために数十のチェックを実行します。また、画像を分析して、たとえば、ユーザが実際のシーンではなく別の (2 次元) 画像を撮影しているかどうかを検出します。

次に、アプリケーションは画像から数百のデータポイントを抽出し、Serelay サーバに送信します (Serelay によると、そのサイズはわずか 15 KB です)。Serelay の SDK を活用することで、他のユーザが画像の真正性をチェックできます。次の図は、その一例を示しています。

CAIと同様に、ユーザは特別なカメラ(この場合はSerelayスマートフォンアプリケーション)で画像を撮影する必要があります。ただし、Serelayは画像にメタデータを埋め込むのではなく、彼ら自身のサーバへ保存します。

まとめ

既存の画像処理技術では、メッセージを改ざんするために操作された画像を検出するのに十分ではありません。これはフェイクニュースとの戦いにおける問題です。幸いなことに、いくつかの解決策が開発されています。これらのソリューションは、カメラで撮影した瞬間から画像に対する信頼性を構築することを目指し、画像の真正性の証明に必要な追加のメタデータを画像に関連付けます。